| 일 | 월 | 화 | 수 | 목 | 금 | 토 |

|---|---|---|---|---|---|---|

| 1 | 2 | |||||

| 3 | 4 | 5 | 6 | 7 | 8 | 9 |

| 10 | 11 | 12 | 13 | 14 | 15 | 16 |

| 17 | 18 | 19 | 20 | 21 | 22 | 23 |

| 24 | 25 | 26 | 27 | 28 | 29 | 30 |

- 데이터베이스

- SQL

- 코딩테스트

- JSP/Servlet

- 운영체제

- 정보처리기사필기

- 머신러닝

- 텍스트마이닝

- 중학1-1

- 컴퓨터구조

- pandas

- 중학수학

- 데이터입출력구현

- 컴퓨터비전

- CSS

- html/css

- 딥러닝

- numpy/pandas

- 정수와유리수

- 영어공부

- 정보처리기사실기

- 연습문제

- 파이썬

- CNN

- 데이터분석

- 혼공머신

- 자바 실습

- 파이썬라이브러리

- C++

- 자바

- Today

- Total

클라이언트/ 서버/ 엔지니어 "게임 개발자"를 향한 매일의 공부일지

CNN 9 - 객체 탐지를 하는 YOLO v8 모델 실습 2 - 가위 바위 보 객체 탐지 모델 학습시키기 본문

이이서 가위 바위 보 객체 탐지하는 실습을 진행해 보겠다. 아침 공부할 시간이 이제 30분도 남지 않아서 서둘러야겠다.

YOLO v8 객체 탐지 실습해보기

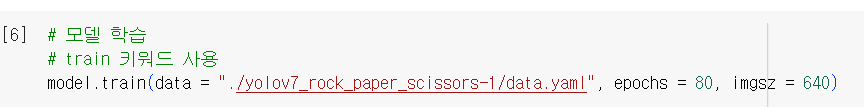

이제 불러온 가위 바위 보 객체 탐지 모델을 학습시킬 차례이다.

data의 경로를 yaml에 가서 붙여 넣는데 줄이 너무 길기에 상대경로로 점을 찍어서 앞의 부분을 지우면 된다. 이 모델을 가져오는데 10분 정도 걸린다.

너무 긴 관계로 일부만 캡처해 보았다.

모델 학습에 붙여 넣을 경로

runs에 가면 train에 이러한 파일이 들어있다.

weights에 들어가면 이러한 파일이 들어있는데 베스트 모델을 담아놓은 것이 best.pt이다.

이 안에 있는 weights 안의 best.pt의 경로를 복사하여 괄호 안에 넣는다.

이미지 데이터는 yolov7 안에 있는 images 폴더 안에 있는 이미지의 경로를 복사하여 붙여 넣는다. 아래쪽에 사진 이미지를 클릭하여 확인하고 잘 가위, 바위, 보가 뚜렷하게 잘 나온 것으로 선택한다.

내가 선택한 사진은 이것이다. 사진 옆에 보면 오른쪽에 세 개의 점이 보이는데 그걸 눌러서 경로를 복사하여 코드 안에 붙여 넣는다.

그런 다음 runs 안에 detect 폴더 경로를 복사한 후 옆에 predict라고 추가한다. 모든 실행 내역이 runs 안에 생긴다. 그런 다음 예측 코드도 작성해 준다. conf는 신뢰도로 몇 퍼센트 확신하는지 정도이다.

지난 시간에 학습했던 모델을 예로 들어보면 위에 빨간색 테두리 위에 친칠라 하고 숫자가 써 있는데, 0.8이 80% 확신한다는 말이다.

실행하면 결과가 어디에 저장되었는지 표시된다.

이렇게 폴더에 직접 가서 확인하지 않고 맵플롯립으로 이미지를 출력할 수 있다. 예측률은 95% 가위로 확신하고 있다. 하지만 이미지가 모두 푸드댕댕하니 외계인이 되고 말았다. 왜 그럴까?

원래는 RGB 컬러를 파이썬으로 출력할 때는 BGR로 빨간색과 파란색이 바뀌어서 출력되기 때문이다. 컬러를 convert로 바꾸면 원래 색상으로 돌아온다.

학습을 마치고

시간 안에 객체 탐지까지 모든 수업을 다 듣고 정리해 볼 수 있어서 다행이었다. 살펴보니 책으로 하는 건 저녁에 집에 와서 하면 충분히 다 할 수 있을 것 같다.

이제 갈 준비를 서둘러야겠다.

'인공지능 > 딥러닝' 카테고리의 다른 글

| 합성곱 신경망 10 - 객체 탐지 2 : YOLO 객체 탐지 1 <Darknet YOLO 모델 추론하기> (0) | 2024.10.31 |

|---|---|

| 합성곱 신경망 9 - 객체 탐지 1 : 텐서플로 허브 활용 (1) | 2024.10.31 |

| CNN 8 - 객체 탐지를 하는 YOLO v8 모델 실습 1 : 가위 바위 보 객체 탐지하는 모델 가져오기 (0) | 2024.10.30 |

| CNN 7 - 객체 탐지를 하는 YOLO v6 모델 실습 3 : 사전 학습된 모델 가져와서 친칠라 라벨링 학습 완료하기 (0) | 2024.10.30 |

| CNN 6 - 객체 탐지를 하는 YOLO v6 모델 실습 2 : roboflow에서 라벨링한 데이터 가져와서 코랩에 연결하기 (0) | 2024.10.30 |